Згідно з загальноприйнятою мудрістю: «Якщо не хочеш, щоб твої дані використовували, відмовся від усього».

Ми кажемо: «Якщо ваші дані все одно збираються, то розумніше впливати на те, як вони використовуються».

Це не питання: «Чи повинні компанії мати мої дані?» (Вони вже їх мають).

Справжнє питання полягає в тому: «Чи повинні мої дані сприяти створенню кращої штучної інтелектуальної системи для всіх?»

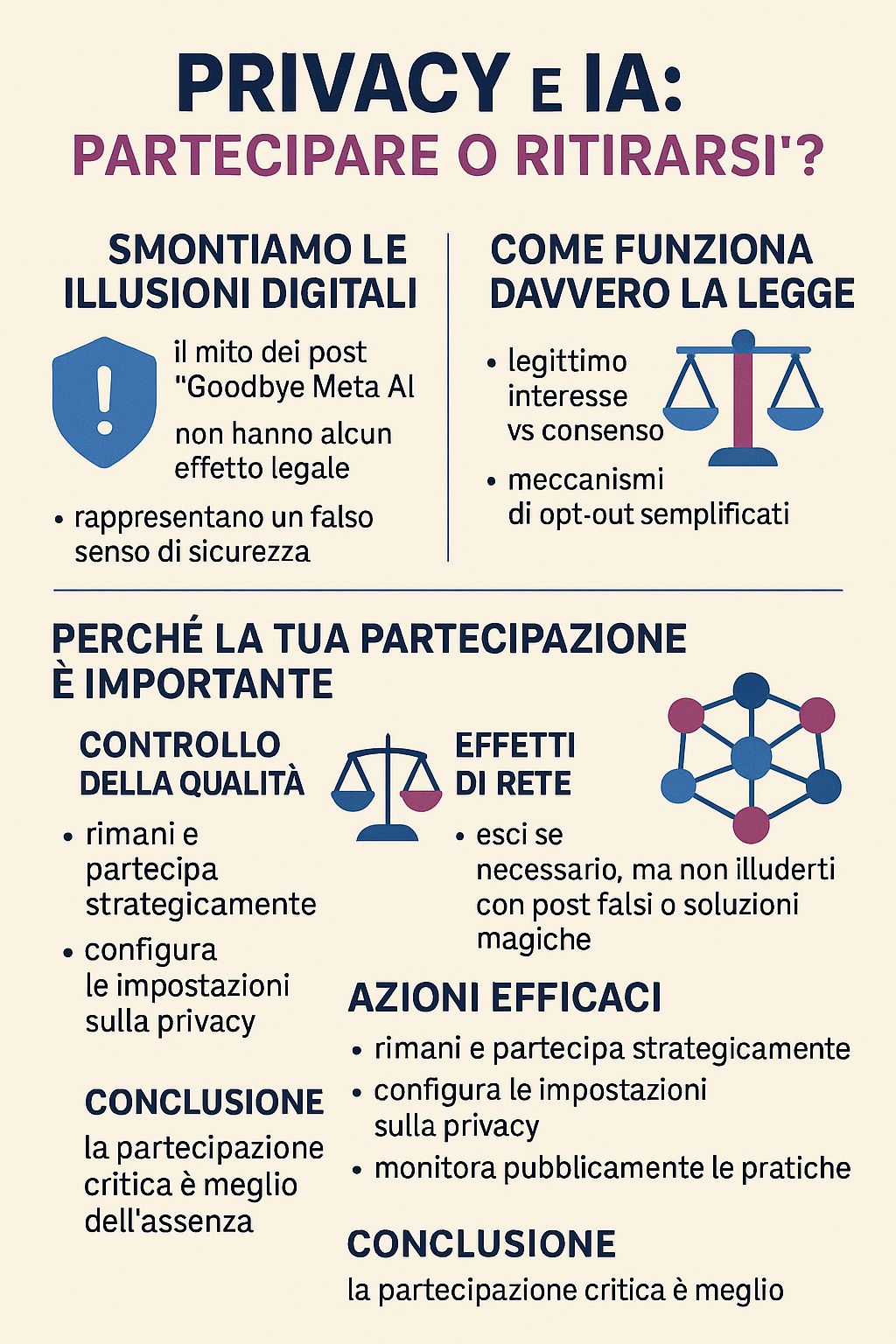

Перш ніж будувати серйозну аргументацію, необхідно розвіяти небезпечну ілюзію, яка поширюється в соціальних мережах: вірусні пости «Goodbye Meta AI», які обіцяють захистити ваші дані, просто поділившись повідомленням.

Незручна правда: ці дописи є повністю фальшивими і можуть зробити вас більш вразливими.

Як пояснює сама Meta, «поширення повідомлення «Goodbye Meta AI» не є дійсною формою протесту». Ці дописи:

Вірусний успіх цих публікацій виявляє більш глибоку проблему: ми віддаємо перевагу простим і ілюзорним рішенням, а не складним і обґрунтованим рішенням. Поділившись публікацією, ми відчуваємо себе активними, не докладаючи зусиль, щоб дійсно зрозуміти, як працюють наші цифрові права.

Але приватність не захищається мемами. Вона захищається знаннями та свідомими діями.

З 31 травня 2025 року Meta запровадила новий режим навчання штучного інтелекту, використовуючи як правову основу «законний інтерес» замість згоди. Це не лазівка, а законний інструмент, передбачений GDPR.

Законний інтерес дозволяє компаніям обробляти дані без явного згоди, якщо вони можуть довести, що їх інтереси не переважають права користувача. Це створює сіру зону, де компанії «підганяють закон під себе» за допомогою внутрішніх оцінок.

Використання неанонімізованих даних пов'язане з «високим ризиком інверсії моделі, витоку пам'яті та вразливості вилучення». Необхідна обчислювальна потужність означає, що лише суб'єкти з дуже високою потужністю можуть ефективно використовувати ці дані, створюючи системні асиметрії між громадянами та великими корпораціями.

Тепер, коли ми з'ясували юридичні та технічні аспекти, давайте обговоримо аргументи на користь стратегічної участі.

Коли свідомі люди відмовляються, ШІ навчається на тих, хто залишається. Ви хочете, щоб системи ШІ базувалися переважно на даних про людей, які:

Упередження в ШІ виникають, коли дані для навчання не є репрезентативними. Ваша участь допомагає забезпечити:

Системи ШІ вдосконалюються завдяки масштабу та різноманітності:

Якщо ви використовуєте функції на основі штучного інтелекту (пошук, переклад, рекомендації, інструменти доступності), ваша участь допомагає поліпшити їх для всіх, включаючи майбутніх користувачів, які найбільше їх потребують.

Ваша конфіденційність не змінюється істотно між опцією «opt-in» та «opt-out» для ШІ. Ті самі дані вже використовуються:

Різниця полягає в тому, чи сприяють ці дані також поліпшенню ШІ для всіх, чи служать лише безпосереднім комерційним інтересам платформи.

Саме тому відповідальні люди, такі як ви, повинні брати участь у цьому процесі. Відмова від участі не зупинить розвиток ШІ, а лише позбавить вас можливості висловити свою думку з цього приводу.

Системи штучного інтелекту будуть розроблятися в будь-якому випадку. Питання полягає в тому, чи буде це відбуватися за участю людей, які критично підходять до цих питань, чи без них?

Зрозуміло. Але врахуйте таке: ви б хотіли, щоб системи ШІ створювалися з участю людей, які поділяють ваш скептицизм щодо великих корпорацій, чи без них?

Саме твоя недовіра є причиною, чому твоя критична участь є такою цінною.

Штучний інтелект стає реальністю, незалежно від того, чи берете ви в цьому участь, чи ні.

Ваш вибір полягає не в тому, чи буде створено ШІ, а в тому, чи буде створений ШІ відображати цінності та перспективи людей, які ретельно обмірковують ці питання.

Відмова від участі – це як не голосувати. Це не зупинить вибори, а лише означає, що результат не враховуватиме твій внесок.

У світі, де тільки гравці з надзвичайно високою обчислювальною потужністю можуть ефективно інтерпретувати та використовувати ці дані, ваша критична думка під час навчання може мати більший вплив, ніж ваша відсутність.

Залишайтеся і беріть участь стратегічно, якщо:

А тим часом:

Але не обманюйте себе:

Ваша індивідуальна відмова має мінімальний вплив на вашу конфіденційність, але залишатися має реальний вплив на всіх.

У світі, де системи штучного інтелекту визначатимуть потік інформації, рішення та взаємодію між людьми і технологіями, питання полягає не в тому, чи повинні ці системи існувати, а в тому, чи повинні вони враховувати точку зору таких вдумливих і критичних людей, як ви.

Іноді найрадикальнішим вчинком є не відмова. Часто найрадикальнішим вчинком є залишитися і переконатися, що твій голос буде почутий.

Анонімний

Не йдеться про сліпу довіру до компаній або ігнорування проблем, пов'язаних із конфіденційністю. Йдеться про усвідомлення того, що конфіденційність захищається не мемами, а стратегічною та свідомою участю.

В екосистемі, де асиметрія влади є надзвичайно великою, ваш критичний голос у навчанні ШІ може мати більший вплив, ніж ваша протестна відсутність.

Яким би не був твій вибір, обирай свідомо, а не під впливом цифрових ілюзій.

Окремий абзац про симпатію до «пустельників приватності» — тих чистих душ, які вірять, що можуть повністю уникнути цифрового відстеження, живучи офлайн, як тибетські ченці 2025 року.

Спойлер: навіть якщо ви переїдете жити в віддалену хатину в Доломітових Альпах, ваші дані вже будуть всюди. Ваш сімейний лікар використовує цифрові системи. Банк, в якому ви зберігаєте заощадження для покупки дров, відстежує кожну транзакцію. Супермаркет у селі має камери та системи електронних платежів. Навіть поштар, який приносить вам рахунки, сприяє створенню логістичних наборів даних, які живлять алгоритми оптимізації.

Повна цифрова ізоляція в 2025 році означає, по суті, самоізоляцію від громадянського суспільства. Ви можете відмовитися від Instagram, але не можете відмовитися від системи охорони здоров'я, банківської системи, освіти або роботи без драматичних наслідків для якості життя.

І поки ти будуєш свою хатину проти 5G, твої дані продовжують існувати в базах даних лікарень, банків, страхових компаній, муніципалітетів, податкових органів і все одно використовуються для навчання систем, які впливатимуть на майбутні покоління.

Парадокс відлюдника: твоя протестна ізоляція не заважає навчанню систем штучного інтелекту на даних людей, які менш обізнані, але позбавляє тебе можливості впливати на їхній розвиток у більш етичному напрямку.

По суті, ти завоював незайману моральну чистоту того, хто спостерігає за історією з трибун, тоді як інші - менш просвітлені, але більш присутні - пишуть правила гри.

Яким би не був твій вибір, обирай свідомо, а не під впливом цифрових ілюзій.

Цитовані статті:

Додаткова інформація про GDPR та законні інтереси:

Офіційні джерела:

Конкретні дії: якщо ви перебуваєте в Європі, перевірте офіційні процедури відмови від участі у Гаранті конфіденційності. Для отримання загальної інформації ознайомтеся з налаштуваннями конфіденційності та умовами надання послуг вашої платформи. І пам'ятайте: жоден допис у соціальних мережах не має юридичної сили.